Heeft John Smith de winkelwagen verlaten?

Winkeliers hebben geklaagd over een “serial cart abandoner” genaamd John Smith. Wat blijkt, John Smith is een Google Bot.

Google heeft een systeem ontwikkeld om er zeker van te zijn dat de prijzen die op de productpagina worden getoond overeen komen met de prijzen in de checkout.

Komen deze prijzen niet overeen, dan keurt Google het niet goed en verifieert het de prijzen niet.

Als jij producten upload in het Google Merchant center geef jij ook automatisch toestemming aan Google om dit type crawls uit te voeren.

Dit kan vertekende resultaten opleveren als jij meet hoeveel verlaten winkelmandjes er zijn geweest in jouw webshop. Uitschakelen is ook geen optie, dan kun je ook geen gebruik meer maken van het Google Merchant Center.

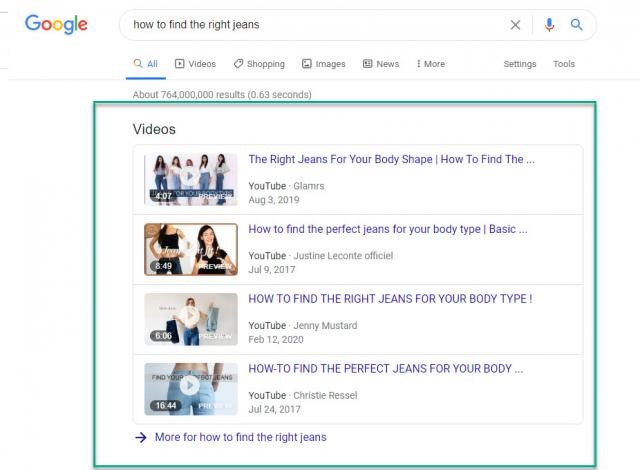

Google test met video’s in een lijstweergave in plaats van carrousel

Google gaat testen met een lijstweergave van video’s. Dit is van invloed op de zoekresultaten in Google, Organische resultaten op basis van zoekwoorden, worden hierdoor namelijk verder naar beneden gedrukt, en komen onder de vouw terecht.

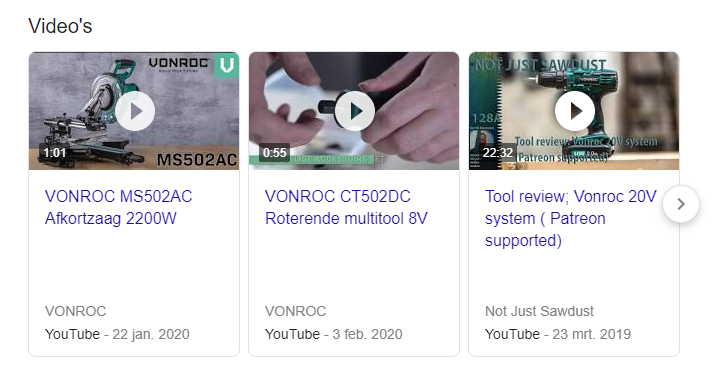

Huidige weergave: De carrousel

Test Google: Lijstweergave

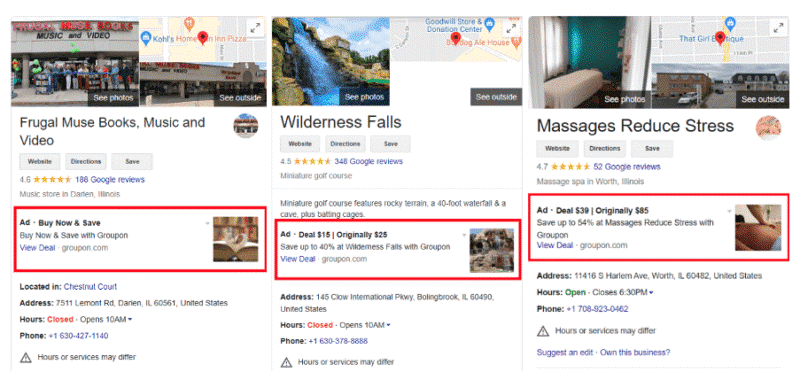

Google test met adverteren op lokale bedrijfsprofielen

Google test opnieuw met adverteren op lokale bedrijfsprofielen (GMB). Je kan als adverteerder je niet aan- of afmelden voor deze vorm van adverteren. De advertenties die getoond worden lijken allemaal verbonden te zijn met de bedrijven. Dus is het bedrijfsprofiel van een bedrijf van zich richt op eten, dan zullen de advertenties over eten gaan etc.

De advertenties worden getoond op zowel desktop en mobiel en is op dit moment voornamelijk te zien bij restaurants en bezorgservices.

De Rich Results Tester

De Rich Result tester is nu volledig uitgerold en is de opvolger van de Structured Data tester.

De Rich Result tester biedt beter en overzichtelijker inzicht of gestructureerde gegevens correct aan de broncode zijn toegevoegd. Het is meer ingespeeld op nieuwere gestructureerde data als HowTo en FAQ en geeft de mogelijkheid om hier direct een voorbeeld van te zien in de zoekmachine. Gebruik dus voortaan deze tool wanneer je gestructureerde gegevens wilt testen.

Een alternatieve manier om met .xml sitemaps om te gaan

Sitemaps zijn belangrijk voor het vindbaar maken van (nieuwe) pagina’s. En hoe beter een sitemap gelaagd is (aparte sitemap per type pagina, niet teveel pagina’s per sitemap) hoe sneller Google de URL’s zal indexeren. Het artikel haalt een voorbeeld aan waarbij enkel door een sitemap beter te verdelen het aantal geïndexeerde pagina’s omhoog is gegaan. I.p.v. 5 sitemaps met max. 50.000 pagina’s, werden er 15 sitemaps met max. 10.000 pagina’s gehanteerd waardoor het aantal geïndexeerde URL’s al steeg met 18%. Hanteer dus niet teveel URL’s per sitemap. Bij WooCommerce is dit goed geregeld en wordt er per 1.000 pagina’s al een nieuwe sitemap gemaakt (voor producten), maar bij Magento is dit bijv. niet zo.

Daarnaast wordt er geschreven over een alternatief voor het gebruiken van sitemaps zodat nieuwe pagina’s nog sneller geïndexeerd worden.

- Hanteer één sitemap met alle nog niet gecrawlde/geïndexeerde URL’s (deze mag dan niet te groot zijn, anders splitsen in meerdere sitemaps).

- Log wanneer Googlebot een URL uit deze sitemap crawlt/indexeert

- Plaats deze URL vervolgens naar een reguliere sitemap

Op deze manier dwing je Google om langs een sitemap met nog niet gevonden URLs te gaan, i.p.v. dat Google deze uit een sitemap moet halen waarin deze al tussen geïndexeerde URL’s staat. Voor dit alternatief is wel hulp nodig van een developer, maar kan met name voor sites met veel producten en categorieën een goed alternatief zijn om indexatie te bespoedigen.